ANUNCIE AQUI

O Gartner anunciou ter identificado pontos cegos críticos, decorrentes de riscos negligenciados e consequências não intencionais da adoção da IA generativa (GenAI). Os diretores de informação (CIOs) devem abordar proativamente esses desafios ocultos para garantir a concretização do valor da GenAI e evitar o fracasso de projetos de IA, afirmam consultores da empresa. “ As tecnologias e técnicas de IA de última geração estão evoluindo em um ritmo sem precedentes, comparável apenas à grande expectativa em torno delas, o que torna desafiador para os CIOs navegar nesse cenário dinâmico”, disse Arun Chandrasekaran , Vice-Presidente Analista Sênior da Gartner, durante o Gartner IT Symposium/Xpo , que aconteceu na semana passada em Kochi, Índia.

Leia também

Gartner: 91% apontam mais investimento em cyber

Gartner: empresas querem menos fornecedores de segurança

Embora as organizações frequentemente se concentrem nos desafios imediatos da IA de Geração, como valor comercial, segurança e prontidão de dados, podem negligenciar pontos cegos críticos, pois estes são efeitos de segunda ou terceira ordem que geralmente não são visíveis de imediato. Riscos como IA paralela, dívida técnica, erosão de competências, exigências de soberania de dados, problemas de interoperabilidade e dependência de fornecedores representam correntes subterrâneas ocultas que podem comprometer o sucesso a longo prazo.

A Gartner prevê que, até 2030, esses pontos cegos criarão a linha divisória entre as empresas que escalam a IA de forma segura e estratégica e aquelas que ficam presas, ultrapassadas ou disruptadas internamente.

Para se manterem competitivos e resilientes, os CIOs devem enfrentar tanto os desafios visíveis quanto os riscos ocultos associados à adoção da IA de Geração e priorizar a resolução dos seguintes pontos cegos:

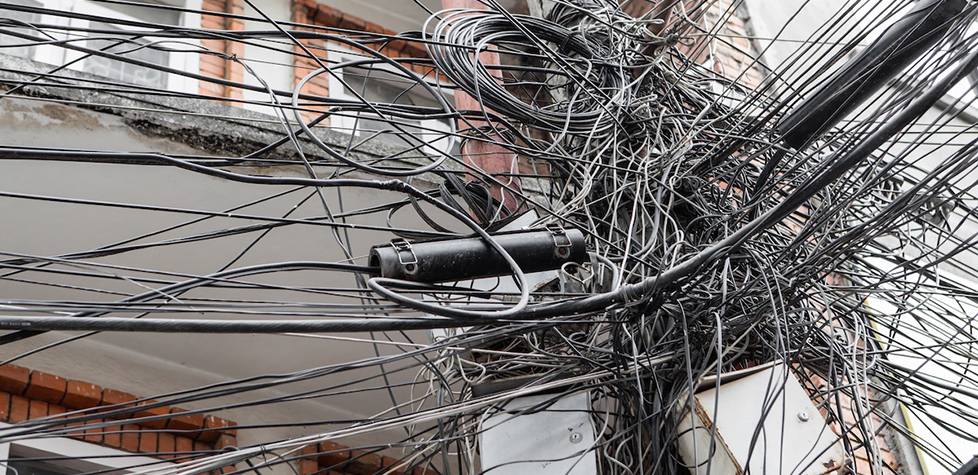

Explosão da Shadow IA

Uma pesquisa da Gartner com 302 líderes de cibersegurança, realizada entre março e maio de 2025, revelou que 69% das organizações suspeitam ou têm evidências de que seus funcionários estão usando inteligência artificial genérica (GenAI) pública proibida. A rápida adoção de ferramentas de IA não autorizadas pode levar a impactos visíveis e invisíveis, como perda de propriedade intelectual, exposição de dados e aumento dos riscos de segurança. A Gartner prevê que, até 2030, mais de 40% das empresas sofrerão incidentes de segurança ou de conformidade relacionados à IA paralela não autorizada.

“Para lidar com esses riscos, os CIOs devem definir políticas claras para toda a empresa em relação ao uso de ferramentas de IA , realizar auditorias regulares para atividades de IA paralela e incorporar a avaliação de riscos da GenAI em seus processos de avaliação de SaaS”, disse Chandrasekaran.

Dívida técnica em IA

A Gartner prevê que, até 2030, 50% das empresas enfrentarão atrasos nas atualizações de IA e/ou aumento nos custos de manutenção devido à dívida técnica não gerenciada da GenAI.

“As empresas estão entusiasmadas com a velocidade de entrega da GenAI. No entanto, o custo extremamente elevado de manutenção, correção ou substituição de artefatos gerados por IA, como código, conteúdo e design, pode corroer o retorno sobre o investimento prometido pela GenAI”, disse Chandrasekaran. “Ao estabelecer padrões claros para revisar e documentar ativos gerados por IA e rastrear métricas de dívida técnica em painéis de TI, as empresas podem tomar medidas proativas para evitar interrupções dispendiosas.”

Crescente demanda por soberania de dados e IA

A Gartner prevê que, até 2028, 65% dos governos em todo o mundo irão introduzir alguns requisitos de soberania tecnológica para melhorar a independência e proteger-se contra interferências regulatórias extraterritoriais.

Restrições regulatórias sobre o compartilhamento transfronteiriço de dados ou modelos podem retardar as implementações de IA em toda a empresa, aumentar o custo total de propriedade (TCO) e resultar em resultados abaixo do ideal.

Para enfrentar esses desafios, os CIOs devem incorporar a soberania de dados em suas estratégias de IA desde o início, envolvendo as equipes jurídicas e de conformidade desde cedo e priorizando fornecedores que atendam aos seus requisitos de soberania de dados e IA.

Erosão de habilidades

A dependência excessiva da IA pode corroer conhecimentos humanos essenciais, julgamento e saberes tácitos que não são facilmente codificados ou substituíveis. Essa erosão ocorre gradualmente e muitas vezes passa despercebida, de modo que os CIOs podem não reconhecer o risco até que a empresa tenha dificuldades para funcionar sem IA ou quando a IA falhe em casos extremos que exigem intuição humana.

“Para evitar a perda gradual de memória e capacidade empresarial, as organizações devem identificar onde o julgamento e a habilidade humana são essenciais, projetando soluções de IA para complementar, e não substituir, essas habilidades”, disse Chandrasekaran.

Dependência do ecossistema e interoperabilidade

Empresas interessadas em explorar o potencial da IA GenAI em larga escala frequentemente optam por um único fornecedor em busca de rapidez e simplicidade. Essa forte dependência pode impactar a agilidade técnica da empresa e seu poder de negociação futuro em relação a preços, termos ou níveis de serviço.

Muitos CIOs subestimam o quão intimamente seus dados, modelos ou fluxos de trabalho ficam vinculados a APIs específicas de fornecedores, data lakes e ferramentas de plataforma.

“Priorizar padrões abertos, APIs abertas e arquiteturas modulares no design da pilha de IA ajuda as empresas a evitar a dependência de fornecedores”, disse Chandrasekaran. “Além disso, os CIOs devem tornar a interoperabilidade um padrão nos projetos-piloto e avaliações do GenAI.”

.png) há 4 meses

82

há 4 meses

82

Portuguese (BR) ·

Portuguese (BR) ·