ANUNCIE AQUI

Agentes de inteligência artificial (IA) vieram para apoiar um novo momento quando o assunto é produtividade nas empresas. Estes sistemas processam informações de diversos formatos e fontes de forma simultânea para conversar entre si, aprender e tomar decisões, além de trabalhar com outros agentes para simplificar fluxos de tarefas e processos.

O potencial destas ferramentas é imenso. Tanto que o mercado de agentes de IA deve registrar uma taxa de crescimento anual composto de 45% nos próximos cinco anos, segundo a Boston Consulting Group (BCG). A consultoria aponta que os casos de sucesso no uso da tecnologia já se multiplicam em segmentos como bancos, bens de consumo, indústria farmacêutica e outros, onde já há notícia de redução drástica de custos com sua adoção.

Quando pensamos sobre a redução de custos, uma das frentes em que o uso de agentes de IA pode gerar muitos resultados é o atendimento ao cliente. Os resultados iniciais tendem a ser promissores: a automação funciona e os clientes ficam satisfeitos. Porém, por outro lado, algumas dinâmicas podem acabar resultando no oposto ao que tinha sido planejado.

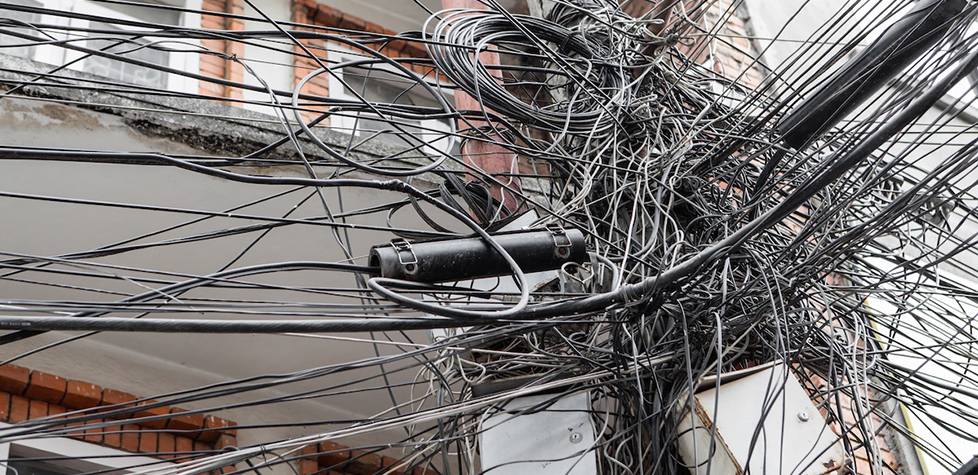

Custos aumentando silenciosamente, múltiplos agentes operando sem uma governança clara e dados sensíveis transitando entre sistemas são apenas alguns dos desafios que podem transformar uma ferramenta inovadora em um problema operacional. Por isso, é essencial que tomadores de decisão tenham em mente alguns pontos de atenção quando falamos sobre múltiplos agentes de IA em ambientes de atendimento.

O custo real dos agentes

Em um contexto de custos de agentes de IA, a primeira métrica que vem à mente são os tokens processados. Em modelos de linguagem comerciais, aproximadamente três quartos de uma palavra correspondem a um token, e cada "chamada" a um grande modelo de linguagem (LLM) consome tokens tanto na entrada quanto na saída.

Quando olhamos para o contexto empresarial, imagine um agente de atendimento que recebe a mesma pergunta de dez clientes diferentes no mesmo dia. Se cada interação aciona o LLM do zero, a organização em questão está pagando dez vezes para obter a mesma resposta que já foi gerada anteriormente.

A primeira estratégia de redução de custos, portanto, é implementar um sistema de cache e reaproveitamento de respostas. Quando uma resposta já foi gerada para um contexto específico, a ideia é reutilizar este material, em vez de fazer uma nova chamada ao modelo e incorrer em custos desnecessários.

Além disso, muitas empresas delegam funções aos LLMs que poderiam ser resolvidas por métodos mais simples e baratos. Aqui cabe a pergunta: você realmente precisa enviar todo o histórico do cliente para o LLM decidir a melhor oferta? Precisa passar toda a conversa para identificar a causa raiz do problema ou um modelo de linguagem natural (NLP) pode extrair as informações relevantes primeiro?

Por exemplo, ao invés de enviar três parágrafos de reclamação de um cliente direto para o LLM (consumindo milhares de tokens), é possível usar um modelo de NLP para extrair o contexto essencial, as palavras-chave e o sentimento. Ao enviar ao LLM apenas quatro linhas com a síntese, você terá reduzido o custo em até 80% mantendo a qualidade da resposta

Ou seja, quando um cliente descreve seu problema em uma longa mensagem, o sistema pode capturar essa informação e, antes de enviá-la ao LLM para geração de resposta, passar por um modelo de NLP que identifica os pontos principais. Apenas o contexto relevante segue adiante, reduzindo drasticamente o consumo de tokens sem comprometer a qualidade da interação

No contexto de múltiplos agentes especializados operando simultaneamente, com cada um potencialmente usando modelos diferentes, a complexidade dos custos aumenta. Um agente de recomendações pode usar um modelo mais sofisticado e caro, enquanto o agente de triagem inicial opera com um modelo mais leve. Rastrear custos por tipo de agente, por tipo de modelo utilizado, e por padrão de uso ao longo do tempo se torna um processo essencial para manter o controle financeiro do uso destes sistemas.

Medindo a performance de agentes de IA

Estabelecer métricas robustas é muito importante para compreender o comportamento real dos agentes em produção. Métricas básicas incluem custo por interação, taxa de sucesso na conclusão de tarefas, tempo médio de resposta e consumo de tokens por tipo de operação. Por outro lado, métricas avançadas como taxa de reprocessamento devido a falhas, número de chamadas encadeadas necessárias para completar tarefas e distribuição de custos entre diferentes modelos fornecem insights valiosos sobre oportunidades de otimização.

Um aumento súbito no consumo de tokens pode indicar loops infinitos no raciocínio do agente, prompts mal otimizados, ou mesmo uso não autorizado. A correlação entre métricas de custo e qualidade de resposta ajuda a encontrar o equilíbrio ideal entre performance e economia, evitando desperdício de recursos e uma deterioração da experiência do usuário.

Também vale pontuar que sistemas de IA, sejam tradicionais ou generativos, podem ter um declínio em performance ao longo do tempo. Por isso, toda interação, toda decisão tomada por agentes deve ser registrada com uma trilha completa de auditoria. Quando o agente master decide recomendar um produto específico para mil clientes, e apenas 120 aceitam a oferta, você precisa entender o porquê.

Essa retroalimentação pode ser automatizada quando for possível. Por exemplo, rastreando as conversões de recomendações, sistematicamente. Quando não for possível automatizar, registros detalhados permitem análises manuais para ajustar prompts, revisar condições de acionamento ou retreinar modelos. As métricas de atendimento tradicionais, como NPS, tempo de resolução, taxa de conversão, devem ser correlacionadas com as decisões dos agentes para identificar onde ajustes são necessários.

O conceito do agente master em governança

Quando se implementa múltiplos agentes especializados, a orquestração é outro ponto crítico para se analisar. Pense em cada agente como um funcionário especialista: um é excelente em comunicação, outro em análise de dados, outro em recomendações de produtos. E para além disso, considere: como coordenar todos estes agentes para atender a um único cliente?

A sugestão para cenários assim é implementar um agente master, que pode ser entendido como o gerente da operação. Este agente coordena todos os especialistas, definindo quando cada um deve ser acionado e em que sequência. Por exemplo, quando um cliente entra em contato, o agente master primeiro solicita o CPF, depois aciona o agente de histórico para buscar chamados abertos, consulta o agente de recomendações para entender o perfil de consumo, e finalmente usa o agente de comunicação para gerar a resposta adequada ao tom e contexto daquele cliente específico.

Essa governança exige definições claras. Nesta orquestração, é preciso estabelecer quais agentes o master pode acessar, em que condições cada agente deve ser acionado, e qual o roteiro de interação. Mais importante ainda, toda tomada de decisão precisa ser registrada. Quando o agente master decide direcionar um cliente para atendimento humano ou oferecer um determinado produto, essa decisão e seus critérios devem ficar documentados para auditoria e melhoria contínua.

De olho nos custos indiretos

Além do uso de tokens, existem custos que muitas vezes são negligenciados. Por exemplo, como você gerencia o versionamento quando usa dezenas de agentes e cada um é usado em múltiplos canais, como call center, chatbot, aplicativo? Quando você atualiza um agente de recomendação da versão 1.0 para 1.1, e como garante que todos os pontos de uso migrem simultaneamente? Todas estas perguntas são essenciais para controlar as despesas geradas por agentes de IA.

Sem um framework de orquestração robusto, o gerenciamento de ecossistemas de agentes pode virar um pesadelo. É preciso lançar mão de processos como CI/CD (Integração e Deploy Contínuos) adaptados para IA, ambientes de staging para testes A/B, e uma capacidade de rollback automático quando algo sai errado. Em empresas grandes, com dezenas ou centenas de agentes distribuídos por múltiplos canais, garantir consistência de versões pode ser um grande desafio.

O custo de equipe para dar suporte a centenas de agentes sem ferramentas adequadas também pode, e muito rapidamente, superar as economias obtidas com automação. Considere também o custo de não ter visibilidade unificada. Se cada equipe desenvolve seus próprios agentes independentemente, surgem redundâncias, inconsistências e dificuldade crescente para auditoria e compliance. O custo do retrabalho quando agentes conflitam entre si ou quando precisam ser desenvolvidos novamente para funcionar em nova arquitetura pode ser expressivo.

A grande verdade é que implementar agentes de IA é só o primeiro passo. Operar estes sistemas de forma sustentável, segura e economicamente viável exige maturidade em governança, uma arquitetura inteligente que combine diferentes tecnologias de IA, e uma obsessão por métricas e auditoria. Essa discussão continua: na segunda parte deste artigo, vamos aprofundar algumas das frentes que introduzimos aqui e explorar outras questões importantes no uso de agentes de IA, como segurança de dados e escolha de modelos.

As empresas que acompanharem a evolução dos agentes de IA e estiverem alertas aos aspectos que abordo nesta série podem reduzir custos, mas também construir vantagens competitivas duradouras por meio de um atendimento consistente, personalizado e cada vez mais eficiente. O futuro do atendimento ao cliente certamente passa por quem souber orquestrar múltiplos agentes com maestria, e não só por quem implementou a tecnologia primeiro.

Lyse Nogueira, senior customer advisor no SAS para América Latina.

.png) há 5 meses

82

há 5 meses

82

Portuguese (BR) ·

Portuguese (BR) ·